05/06/2026

AMD Ryzen 5 9600X : Le caméléon des performances, ou l'art de la polyvalence selon Zen 5

Il est des moments dans l’histoire de la micro-informatique où un simple composant dépasse sa fonction première pour incarner toute une philosophie. Le nouveau processeur AMD Ryzen 5 9600X est de ceux-là. Pour bien comprendre ce qu’il représente, il faut d’abord mesurer le chemin parcouru par son géniteur, AMD. Il n’y a pas si longtemps, Advanced Micro Devices jouait les seconds rôles, celui du challenger courageux mais souvent dépassé face au géant Intel. Ses processeurs Bulldozer, dans les années 2010, étaient de vaillants mais énergivores multicœurs qui peinaient à rivaliser en performance monocœur, laissant les gamers et les utilisateurs lambdas sur leur faim. AMD était alors perçu comme l’option économique, celle que l’on choisit par nécessité budgétaire plus que par réelle conviction technologique.

Puis vint l’étincelle Zen. En 2017, avec l’architecture Zen et la série Ryzen 1000, AMD a non seulement rattrapé son retard, mais a redéfini les règles du jeu. La société a offert plus de cœurs pour moins d’argent, forçant Intel à réagir. Ce fut le début d’une renaissance, une conquête méthodique du public, gagnée à la loyauté sur le front du rapport qualité-prix et de l'innovation. Zen 2 a apporté le PCIe 4.0, Zen 3 a optimisé l’architecture, et Zen 4 a fait le grand saut vers la DDR5 et le socket AM5, un nouveau socle pensé pour durer. Aujourd'hui, avec Zen 5, AMD ne se contente plus de jouer les trouble-fêtes ; il est devenu la référence, celui qui dicte le tempo. La preuve par l'exemple avec ce Ryzen 5 9600X, un processeur taillé pour l'efficacité, la polyvalence, et qui trouve un écrin parfait dans la carte mère Gigabyte X870 EAGLE WIFI7 que nous avons détaillée précédemment.

À première vue, sa fiche technique pourrait sembler modeste : six cœurs, douze threads, une fréquence maximale de 5,4 GHz. Dans un monde où les Ryzen 9 et les Core i9 alignent les cœurs comme des perles, le 9600X fait figure de coureur de fond élégant plutôt que de sprinteur bodybuildé. Mais c'est là que réside tout son génie. Il ne s'agit pas de la puissance brute débridée, mais de la justesse. L'utilisateur qui lui associe la plateforme solide de la X870 EAGLE fait un pari sur l'avenir : celui d'une machine équilibrée, capable de gérer aussi bien une session de gaming compulsive qu'un rendu vidéo en fin de journée, le tout sans faire grimper la facture d'électricité ni le thermostat de la pièce. Un client du site Materiel.net résume parfaitement cette adéquation : "Le rapport performance / prix est parfait pour ma station de travail (conception 3D, découpe laser et création graphique) et la consommation est au top".

Une architecture pensée pour l'efficacité : le grand saut Zen 5

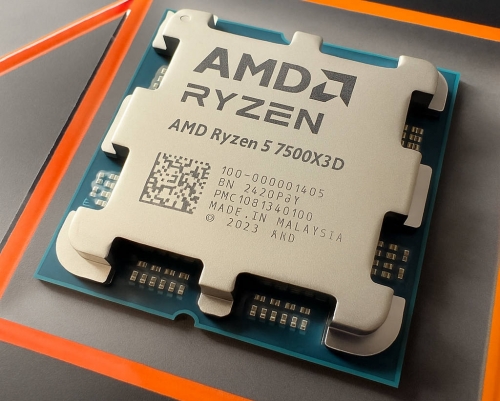

Sous le capot de ce Ryzen 5 9600X bat le cœur de la nouvelle architecture Zen 5, gravée en 4 nm chez TSMC. Si le nombre de cœurs n'a pas changé par rapport à son prédécesseur, le Ryzen 5 7600X, c'est toute la conception de ces cœurs qui a été revue. AMD annonce une augmentation moyenne du nombre d'instructions par cycle (IPC) de 16 %, une progression colossale qui ne doit rien à la fréquence, mais tout à l'intelligence du design. Les unités de calcul ont été élargies, la prédiction de branchement améliorée, et la fenêtre d'exécution des instructions agrandie. Concrètement, pour l'utilisateur, cela signifie que chaque cœur travaille plus intelligemment et plus vite. Les applications les plus courantes, souvent peu optimisées pour exploiter une myriade de cœurs, bénéficient directement de cette puissance monocœur accrue. Naviguer sur le web, ouvrir des logiciels, ou jouer à des jeux qui ne sollicitent que quelques cœurs devient une expérience d'une fluidité déconcertante.

Le choix de conserver six cœurs peut en étonner certains. Pourtant, c'est un choix stratégique. Six cœurs physiques, épaulés par le multithreading pour en gérer douze logiques, représentent aujourd'hui le sweet spot pour une configuration grand public. C'est suffisant pour les jeux les plus récents, qui commencent tout juste à exploiter huit cœurs, et amplement confortable pour le multitâche quotidien (streaming, navigation, suite bureautique). C'est un équilibre qui évite de payer pour des ressources qui resteraient inutilisées. Le processeur devient ainsi le compagnon idéal du Ryzen 5 9600X.

L'autre révolution silencieuse de ce processeur, c'est son Enveloppe Thermique (TDP) annoncée à seulement 65 Watts. C'est une chute spectaculaire par rapport aux 105W du 7600X. Cette sobriété énergétique a des implications concrètes majeures. D'une part, elle réduit la facture d'électricité, un argument qui pèse de plus en plus dans la balance. D'autre part, elle simplifie radicalement le choix du refroidissement. Fini la nécessité d'un gros watercooling bruyant ; un bon ventirad milieu de gamme, voire le ventirad fourni avec certaines cartes mères (attention, ici il n'est pas inclus dans la boîte), suffira à maintenir des températures caniculaires. Un utilisateur sur LDLC confirme : "Chauffe et consomme peu, c'est bon pour l'alimentation". Cette efficacité permet également de concevoir des PC plus compacts, plus silencieux, et plus faciles à vivre au quotidien. C'est la promesse d'une puissance domestiquée.

La puce graphique intégrée : un luxe qui devient une nécessité

Trop souvent négligée, la présence d'un bloc graphique intégré (iGPU) est pourtant l'un des atouts majeurs de ce Ryzen 5 9600X. Comme tous les processeurs de la gamme Ryzen 7000 et 9000, il embarque deux unités de calcul basées sur l'architecture RDNA 2, la même que celle qui équipait les cartes graphiques Radeon RX 6000. Baptisée sobrement "AMD Radeon Graphics", cette puce tourne à une fréquence de 2200 MHz et est loin d'être un simple gadget.

Bien sûr, n'espérez pas jouer à Cyberpunk 2077 en 4K avec. Mais son utilité est multiple et souvent sous-estimée. Elle sert d'abord de dépannage salutaire. Imaginez : votre carte graphique dédiée tombe en panne ou doit être renvoyée en Sav. Avec n'importe quel processeur Intel non-"F" ou ce Ryzen 5 9600X, votre PC n'est pas condamné à rester éteint. Vous pouvez toujours l'allumer, naviguer sur Internet, regarder des vidéos en 4K, faire du travail de bureau, et même jouer à des jeux légers ou rétro. C'est une bouée de sauvetage numérique.

Ensuite, et c'est un point que les créateurs de contenu apprécient, cette iGPU RDNA 2 intègre des accélérateurs matériels pour l'encodage et le décodage vidéo. Pour le montage vidéo, elle peut épauler la carte graphique principale sur certains flux, ou prendre en charge l'affichage des moniteurs secondaires, libérant ainsi les ressources de la carte dédiée pour le rendu 3D. Enfin, pour les amateurs de systèmes multi-écrans, elle offre une flexibilité totale : vous pouvez brancher plusieurs écrans sur la carte mère, via les ports HDMI et DisplayPort de la Gigabyte X870 EAGLE WIFI7, et réserver la puissance de votre gros GPU pour le jeu sur l'écran principal. C'est cette intelligence d'usage qui fait la différence au quotidien.

Sur le champ de bataille des benchmarks : les deux visages de la performance

C'est dans l'arène des tests synthétiques que le Ryzen 5 9600X révèle une personnalité plus complexe. Les chiffres, rapportés par des sites spécialisés comme PCMag, dressent un portrait en clair-obscur. Côté pile, le processeur est un champion toutes catégories. Sur des tests comme Cinebench R23 en simple cœur, il surclasse la concurrence, y compris les puces Intel les plus récentes. Cette performance monocœur est le gage d'une réactivité système à toute épreuve et d'une excellente tenue dans les jeux. C'est d'ailleurs ce que confirme le site de benchmarking PassMark, qui le classe 42ème de tous les temps en performance single thread. Dans les jeux compétitifs comme CS2 ou Valorant, où chaque image compte, il permet d'atteindre des cadences de 400 images par seconde, comme l'a démontré un test vietnamien couplant un Ryzen 9 à une carte Gigabyte X870.

Côté face, en revanche, les tests multicœurs comme Cinebench R23 multi-thread ou Blender révèlent une faiblesse relative face à ses concurrents directs. Le processeur se retrouve non seulement distancé par les Core i5-13600K et 14600K d'Intel, mais il est même talonné, voire dépassé, par un vétéran : le Core i5-12600K, sorti trois ans plus tôt. Ce dernier, fort de ses 10 cœurs (6 performants et 4 efficients), exploite sa supériorité numérique pour rattraper son retard architectural. Sur ces charges de travail très parallélisées, les six cœurs du Ryzen montrent leurs limites.

Faut-il pour autant crier au scandale ? Pas si vite. Comme le souligne un test plus récent du site PCEVA, effectué plusieurs mois après le lancement, la donne a changé. Grâce à des mises à jour du microcode (AGESA) et à l'activation de fonctionnalités comme le PBO (Precision Boost Overdrive) dans les BIOS des nouvelles cartes mères, le Ryzen 5 9600X peut voir ses performances grimper en flèche. En activant le mode "PBO Enhancement" et en passant le TDP de 65W à 105W, l'écart se resserre considérablement, permettant au petit Ryzen de rivaliser avec l'i5-14600K tout en conservant une efficacité énergétique exemplaire. C'est la magie de la plateforme AMD : la performance n'est pas figée dans le marbre au lancement ; elle s'améliore avec le temps, grâce au travail conjoint des ingénieurs et des constructeurs de cartes mères comme Gigabyte. Le Ryzen 5 9600X est donc une toile qui ne demande qu'à être optimisée.

Le rapport qualité-prix ou la quadrature du cercle

Le débat sur la performance multicœurs nous amène inévitablement à la question du prix, l'argument roi d'AMD. À son lancement, son tarif de 279 dollars avait été jugé trop élevé par la presse, le plaçant en porte-à-faux face à des concurrents plus agressifs. Mais le marché a rapidement corrigé le tir. Aujourd'hui, en France, on le trouve couramment aux alentours de 210 à 240 euros. À ce prix-là, le discours change du tout au tout.

Que trouve-t-on pour ce tarif ? Un processeur monté sur le socket AM5, une plateforme qu'AMD s'est engagé à supporter jusqu'en 2027 au moins. C'est la promesse de pouvoir, dans trois ans, retirer ce Ryzen 5 pour le remplacer par un hypothétique Ryzen 11700X sans avoir à changer ni la carte mère ni la mémoire. C'est ce qu'on appelle "investir pour l'avenir". Intel, avec ses changements de socket fréquents, n'offre pas cette sérénité. À ce prix-là, on bénéficie aussi de la dernière connectique : PCIe 5.0 pour les SSD et les cartes graphiques futures, et le support de la mémoire DDR5, qui ne cesse de baisser en prix et d'augmenter en performance . Enfin, on obtient un processeur dont la faible consommation (65W de base) permet de réaliser des économies sur l'alimentation et le refroidissement, répercutant l'investissement initial sur le reste de la configuration.

C'est ici que le mariage avec la Gigabyte X870 EAGLE WIFI7 prend tout son sens. Avec sa carte mère, vous ne laissez aucune miette de performance sur la table. L'iGPU peut utiliser les ports USB4 de la carte, les SSD PCIe 5.0 peuvent exprimer leur plein potentiel, et les fonctions d'overclocking automatique comme le PBO sont parfaitement prises en charge. L'utilisateur "AdrianoD" sur Materiel.net a bien compris cette équation : "La différence de prix avec d'autres gammes n'est pas justifiée, mettez la différence dans la carte graphique, le refroidissement ou le stockage... Ravi de cet achat". C'est exactement la philosophie de cette configuration : un CPU milieu de gamme intelligent, associé à une carte mère généreuse, pour dégager un budget maximal vers ce qui fait vraiment la différence dans les jeux, le GPU.

I5 14400F face au Ryzen 5 9600X dans 9 jeux.

Un caméléon à l'usage : le verdict des utilisateurs

Si les chiffres des benchmarks sont une chose, la satisfaction réelle des acheteurs en est une autre, et elle est éloquente. Les retours sur les sites de vente français sont unanimes : la note moyenne frôle les 10/10. Les mots qui reviennent le plus souvent sont "économique", "polyvalent", "rapport qualité-prix".

Le témoignage de "ChristopheR" est particulièrement évocateur : "Temp au repos: 38° (ventirad artic Freezer 36 CO) dans un Antec performance 1FT bien ventilé. Efficace, réactif, puissant par rapport au 4670k âgé de 12 ans. Ma config démarre Windows 11 en 10 secondes contre plus de 30 avec un vieux sdd sata." . Ce saut générationnel est exactement ce que recherche le grand public : une métamorphose de l'expérience utilisateur, où le PC ne se fait plus jamais attendre.

Un autre utilisateur, "LouisL", vante sa souplesse : "Le Ryzen 5 9600X fait super bien le taf ! Il est rapide, fluide, et les jeux tournent nickel sans prise de tête. Les applis s'ouvrent vite, le multitâche passe crème. Parfait si vous voulez une machine réactive sans vous ruiner". Cette réactivité, cette impression de légèreté, c'est le fruit du travail sur l'IPC et l'efficacité énergétique.

Bien sûr, il faut être lucide. Ce processeur n'est pas fait pour celui qui veut battre des records de rendu vidéo sans investir dans un Ryzen 9. Il n'est pas non plus le roi de la guerre des cœurs. Mais pour l'immense majorité des usages, du gaming à la création amateur en passant par le télétravail, il est non seulement suffisant, mais souverain. Et pour ceux qui voudraient un peu plus de mordant, la marge de manœuvre est là : un passage à 105W dans le BIOS de la X870 EAGLE, et le voilà qui rugit un peu plus fort sans se consumer. Un utilisateur note d'ailleurs que "le TDP est adaptable via BIOS, 65W est très conservateur, 105W est un bon juste milieu" .

En définitive, l'AMD Ryzen 5 9600X est bien plus qu'un simple processeur. Il est le fruit de dix ans d'une stratégie industrielle audacieuse, le symbole de la revanche d'AMD sur son propre destin. C'est un processeur caméléon, capable d'adapter sa consommation et sa puissance à votre besoin du moment, grâce à une plateforme AM5 pensée pour l'avenir. Associé à la Gigabyte X870 EAGLE WIFI7, il forme le cœur d'un PC sans compromis, où l'intelligence technique se met au service de l'expérience humaine. Une machine qui ne se contente pas de performer, mais qui comprend ce que vous attendez d'elle : être là, puissante et discrète, pour vous accompagner dans toutes vos aventures numériques.

AMD Ryzen 5 9600X – Fiche technique simplifiée

Plateforme et architecture

-

Socket : AMD AM5

-

Architecture : Zen 5 (nom de code Granite Ridge)

-

Gravure : TSMC 4 nm FinFET

Cœurs, fréquences et cache

-

Configuration : 6 cœurs / 12 threads

-

Fréquence de base : 3,9 GHz

-

Fréquence boost max. : jusqu’à 5,4 GHz

-

Cache total : 38 Mo

-

Cache L1 : 384 Ko

-

Cache L2 : 6 Mo

-

Cache L3 : 32 Mo

-

Processeur graphique intégré (iGPU)

-

iGPU intégré : oui – AMD Radeon Graphics (RDNA 2)

-

Fréquence graphique : 2200 MHz

-

Nombre de shaders : 128

-

Décodage vidéo matériel : oui

Mémoire et PCIe

-

Support mémoire : DDR5, double canal

-

Fréquence mémoire officielle : jusqu’à 5600 MHz (sans overclocking)

-

Overclocking mémoire : possible via EXPO / XMP

-

Lignes PCIe : PCIe 5.0, jusqu’à 24 lignes

Consommation, températures et refroidissement

-

TDP : 65 W (configurable jusqu’à 105 W via BIOS / PBO)

-

Température maximale de fonctionnement : 95°C

-

Refroidissement : aucun ventilateur inclus dans la boîte

Fonctions et instructions

-

Jeu d’instructions pris en charge :

AMD-V, AES, AVX, AVX2, AVX512, FMA3, MMX-plus, SHA, SSE, SSE2, SSE3, SSE4.1, SSE4.2, SSE4A, SSSE3, x86-64

Prix (France)

-

Tarif constaté : entre 210 € et 240 € TTC (selon revendeurs et promotions).

08:32 Publié dans Actualité, Processeur | Lien permanent | Commentaires (0) |  |

| ![]() Facebook | | |

Facebook | | |

29/05/2026

Wonder Valley ou le mirage toxique de l’IA dans le désert de l’Utah

Au cœur du comté de Box Elder, dans le nord-ouest de l’Utah, un projet d’une démesure inédite menace de transformer un paysage désertique en une dystopie industrielle. Baptisé officiellement Stratos Project et présenté au public sous le nom de marque "Wonder Valley", ce complexe de données artificielles (data centers) est poussé par Kevin O’Leary, le célèbre investisseur milliardaire canadien de l’émission Shark Tank.

L’objectif officiel, martelé par ses promoteurs comme un impératif de sécurité nationale, est de construire le plus grand campus dédié à l’intelligence artificielle au monde. Sur une superficie de plus de 40 000 acres (plus de 160 km²) — soit deux fois la taille  de l’île de Manhattan — O’Leary promet de fournir une puissance de calcul phénoménale via une capacité électrique de 9 gigawatts (GW), soit plus du double de la consommation annuelle totale de l’État de l’Utah. Justifié par la course à la suprématie technologique face à la Chine, le projet est soutenu par l’État via la Military Installation Development Authority (MIDA), une entité spéciale capable d’outrepasser les régulations locales pour des raisons de défense.

de l’île de Manhattan — O’Leary promet de fournir une puissance de calcul phénoménale via une capacité électrique de 9 gigawatts (GW), soit plus du double de la consommation annuelle totale de l’État de l’Utah. Justifié par la course à la suprématie technologique face à la Chine, le projet est soutenu par l’État via la Military Installation Development Authority (MIDA), une entité spéciale capable d’outrepasser les régulations locales pour des raisons de défense.

Pourtant, derrière le vernis des promesses de milliers d’emplois et de leadership technologique se cache un monstre écologique, énergétique et civique. Dans un État déjà asphyxié par une sécheresse historique, où le Grand Lac Salé (Great Salt Lake) se meurt, le projet "Stratos" représente un non-sens absolu. Cet article se propose de détailler les menaces concrètes qu’il fait peser sur les ressources naturelles, le climat local et la santé des habitants, tout en évoquant l’hypothèse glaçante, soulevée par une population de plus en plus méfiante, d’un État surveillé via ce mastodonte numérique.

Les résidents du comté de Box Elder se sont réunis pour déposer deux référendums dans l'espoir de mettre fin au projet Stratos, un centre de données qui pourrait atteindre 44 000 acres de terrain dans le nord de l'Utah.

Un non-sens écologique dans un désert assoiffé

L’argument le plus irresponsable du projet "Stratos" réside dans sa gestion, ou plutôt sa prédation, de l’eau. L’Utah traverse l’une des crises hydriques les plus graves des États-Unis. Le Grand Lac Salé, joyau écologique de la région, a vu son niveau d’eau chuter de près de 7 mètres (22 pieds) depuis 1986, exposant son lit toxique aux vents violents. Dans ce contexte, construire une infrastructure qui engloutit des millions de litres d’eau relève soit de l’inconscience criminelle, soit d’un cynisme économique sans limite.

Pour faire face à la chaleur intense générée par des centaines de milliers de processeurs graphiques (GPU) nécessaires à l’IA, les data centers ont traditionnellement besoin de systèmes de refroidissement par évaporation très gourmands en eau. Selon une analyse de l’impact environnemental, le projet pourrait nécessiter l’équivalent de plus de 16,6 milliards de gallons d’eau par an (environ 62,8 milliards de litres). C’est un volume suffisant pour couvrir les besoins domestiques de plusieurs dizaines de milliers de familles.

Face à la levée de boucliers des habitants — près de 4 000 objections ont été déposées auprès de la division des droits d’eau de l’Utah — les promoteurs ont reculé stratégiquement. Ils ont retiré une première demande de détournement de 1 900 acre-pieds d’eau provenant de Salt Wells Spring, destinée à l’agriculture, pour la convertir à un usage industriel. Mais attention, il ne s’agit pas d’un abandon, bien au contraire. Comme le rapporte The Guardian, le ranch Bar H (propriétaire des terrains) a clairement indiqué qu’il "envisage pleinement d’aller de l’avant" avec une nouvelle demande. Cette manœuvre est odieuse : elle permet de contourner les milliers d’oppositions citoyennes en réinitialisant le processus administratif, forçant chaque opposant à repayer des frais de dossier pour se faire entendre .

Le directeur exécutif de l’Utah Rivers Council, Zachary Frankel, résume l’aberration : "Ce que nous avons fait en tant qu’État en adoptant le projet de loi HB60, c’est faire un pas de plus vers davantage de tempêtes de poussière en retirant un des outils réglementaires de notre boîte à outils pour garder l’eau dans le Grand Lac Salé." Cette nouvelle loi, votée à la hâte, réduit la capacité de l’ingénieur d’État à refuser un projet pour des raisons de "bien-être public", recentrant le débat uniquement sur la pollution ou la pénurie, et ignorant les impacts écologiques globaux.

Le directeur exécutif de l’Utah Rivers Council, Zachary Frankel, résume l’aberration : "Ce que nous avons fait en tant qu’État en adoptant le projet de loi HB60, c’est faire un pas de plus vers davantage de tempêtes de poussière en retirant un des outils réglementaires de notre boîte à outils pour garder l’eau dans le Grand Lac Salé." Cette nouvelle loi, votée à la hâte, réduit la capacité de l’ingénieur d’État à refuser un projet pour des raisons de "bien-être public", recentrant le débat uniquement sur la pollution ou la pénurie, et ignorant les impacts écologiques globaux.

Si l’eau est le premier scandale, la gestion de la chaleur est la seconde insulte faite à l’environnement. Les chercheurs de l’Université d’État de l’Utah sont formels : la charge thermique du projet "Stratos" est tout simplement extrême. Le physicien Rob Davies a réalisé des calculs saisissants. La consommation électrique de 9 GW ne sert pas à faire tourner des moteurs, elle finit presque intégralement en chaleur perdue.

Cette chaleur résiduelle est si monumentale qu’elle équivaudrait à l’explosion de 23 bombes atomiques par jour relâchées dans l’atmosphère locale. Les conséquences sur le microclimat de la vallée de Hansel sont terrifiantes : Davies prévoit que les températures diurnes pourraient grimper de 1,1°C à 2,7°C (2°F à 5°F), tandis que les températures nocturnes bondiraient de 4,4°C à 6,6°C (8°F à 12°F). Dans une région déjà désertique, ce réchauffement localisé accélérerait l’assèchement des sols, transformerait durablement l’écosystème et augmenterait la fréquence des vagues de chaleur pour les rares habitants et la faune locale.

Et que dire de la pollution atmosphérique ? Pour alimenter ce Léviathan, Kevin O’Leary prévoit de construire ses propres centrales électriques sur site, fonctionnant au gaz naturel. Il ose le qualifier de "propre". C’est une contre-vérité dangereuse. Brûler du gaz fossile pour alimenter l’IA augmenterait les émissions de gaz à effet de serre de l’État de l’Utah d’environ 50 %. Pendant que le monde scientifique hurle à la nécessité de réduire notre empreinte carbone, l’Utah s’apprête à devenir le haut lieu de la consommation énergétique la plus sale pour une technologie dont l’utilité sociale reste à prouver.

Un système de surveillance géant ? L’inquiétude légitime des citoyens

Au-delà des impacts environnementaux objectifs, une inquiétude plus sourde, plus politique, grandit parmi la population. Cette défiance s’enracine dans un terreau particulièrement fertile : celui de l’effondrement silencieux du modèle économique américain. Car pour comprendre la méfiance des habitants du comté de Box Elder à l'égard d'un milliardaire venu de l'extérieur promettre un paradis technologique, il faut d'abord mesurer l’ampleur du désastre économique dans lequel les États-Unis s’enfoncent. Le projet "Wonder Valley" ne naît pas dans un vide social : il émerge au cœur d’une Amérique rongée par la dette, étranglée par l’inflation, désindustrialisée et traversée par une crise de sens sans précédent.

Le premier symptôme de cet effondrement est la dette publique, qui a franchi un seuil historique. Au printemps 2026, le ratio dette/PIB des États-Unis a dépassé les 100 % pour la première fois depuis la Seconde Guerre mondiale en temps de paix. Fin mars, la dette détenue par le public s'élevait à 31 270 milliards de dollars, dépassant le PIB nominal de 31 220 milliards . Mais le chiffre le plus vertigineux est ailleurs : la dette brute totale a franchi la barre des 39 000 milliards de dollars en mars 2026 .

Le rythme de cette accumulation est tout simplement inédit hors période de guerre ou de crise financière majeure. Il n’a fallu que cinq mois pour passer de 38 000 à 39 000 milliards de dollars . Selon la Peter G. Peterson Foundation, chaque Américain porte désormais sur ses épaules l’équivalent de 11,4 tonnes de dollars  de dette publique . Le président du Committee for a Responsible Federal Budget (CRFB), Maya MacGuineas, résume l'absurdité de la situation en ces termes : « La dette nationale dépore désormais la taille de notre économie, soit environ le double de la moyenne historique » .

de dette publique . Le président du Committee for a Responsible Federal Budget (CRFB), Maya MacGuineas, résume l'absurdité de la situation en ces termes : « La dette nationale dépore désormais la taille de notre économie, soit environ le double de la moyenne historique » .

Cette explosion n'est pas un détail technocratique. Elle signifie concrètement que l'État fédéral consacre une part croissante de ses ressources à servir les intérêts de sa propre dette. En 2026, les seuls intérêts de la dette devraient dépasser les 1 000 milliards de dollars par an . C'est autant d'argent qui n'est plus investi dans les écoles, les hôpitaux, les infrastructures ou les filets sociaux. Pendant que les ménages voient leurs services publics s'éroder, des milliardaires comme Kevin O'Leary viennent réclamer des exemptions fiscales massives (80 % de réduction de taxe foncière, taxe sur l'énergie réduite de 6 % à 0,5 %) . L’indécence saute aux yeux.

Le deuxième front de cette crise est celui de la valeur de la monnaie. Depuis le début de l'année 2025, le dollar américain a perdu environ 10 % de sa valeur sur l'indice des changes, marquant sa plus forte baisse sur six mois depuis un demi-siècle . Ce déclin, qualifié de « déclin silencieux » par les économistes, agit comme une taxe cachée sur le pouvoir d'achat des ménages.

Kenneth Rogoff, économiste à Harvard et ancien chef économiste du FMI, est sans équivoque : « Le dollar était dans un marché haussier depuis quinze ans. Il est encore largement surévalué, et je pense qu'il pourrait perdre encore 15 % supplémentaires dans les cinq à six ans à venir » . Morgan Stanley abonde dans ce sens, prévoyant une chute de 10 % supplémentaires d'ici la fin de l'année 2026 .

Kenneth Rogoff, économiste à Harvard et ancien chef économiste du FMI, est sans équivoque : « Le dollar était dans un marché haussier depuis quinze ans. Il est encore largement surévalué, et je pense qu'il pourrait perdre encore 15 % supplémentaires dans les cinq à six ans à venir » . Morgan Stanley abonde dans ce sens, prévoyant une chute de 10 % supplémentaires d'ici la fin de l'année 2026 .

Les conséquences sont déjà tangibles dans la vie quotidienne. Le prix du café moulu a bondi à 9,61 dollars la livre en mars 2026, soit une hausse de près de 19 % en un an, sous l'effet conjugué de la chute du dollar face au réal brésilien et des perturbations des chaînes d'approvisionnement . Les prix des produits importés ont augmenté de 2,1 % sur les douze mois se terminant en mars 2026, leur plus forte hausse depuis décembre 2024 . Partir en vacances au Mexique, première destination des Américains, coûte désormais 16 % plus cher qu'au début de l'année 2025 .

Cette dépréciation monétaire n'est pas un accident de parcours. Elle reflète une perte de confiance structurelle dans la gestion américaine, exacerbée par des guerres commerciales et une planche à billets toujours plus active. Pendant que la valeur de leur épargne et de leur travail s'érode, les résidents de l'Utah voient arriver un projet qui engloutira l'équivalent de 23 bombes atomiques en chaleur perdue par jour . Le contraste est saisissant : l'argent se dévalue, mais les milliardaires trouvent toujours des fonds pour bâtir des cathédrales technologiques dont la nécessité sociale n’est pas démontrée.

Le troisième cercle de l'enfer économique américain, celui qui touche le plus durement les classes populaires et moyennes, est la destruction massive d'emplois industriels. Là encore, les chiffres donnent le vertige.

Entre avril 2025 et février 2026, plus de 89 000 emplois manufacturiers ont été supprimés aux États-Unis, soit une moyenne de 9 000 pertes par mois . Les secteurs les plus durement touchés sont la métallurgie primaire (hausse de 17,4 % du prix des intrants importés), la fabrication de matériel électrique et l'habillement . Les conséquences humaines sont brutales. Chez John Deere, 238 travailleurs ont été licenciés dans trois usines en août 2025, la direction invoquant explicitement la hausse des droits de douane .

Au total, sur l'ensemble des secteurs « cols bleus » (manufacture, construction, transport, services publics, etc.), ce sont près de 190 000 emplois qui ont disparu depuis l'annonce des droits de douane réciproques en avril 2025 . Et les perspectives ne sont guère meilleures. Le Bureau of Labor Statistics a révisé à la baisse les chiffres de l'emploi pour 2025 : sur l'ensemble de l'année, seulement 181 000 emplois ont été créés, soit une moyenne mensuelle de 15 000 emplois, un niveau habituellement réservé aux périodes de récession .

Pour les habitants du comté de Box Elder, ces chiffres ne sont pas des abstractions. Ce sont des voisins, des membres de la famille, qui ont perdu leur emploi dans les usines de l'Utah, dans les mines, dans les ateliers de fabrication. Et c'est dans ce contexte de détresse économique que débarque Kevin O'Leary avec son projet « Wonder Valley ». Les promoteurs promettent des milliers d'emplois - un chiffre très vague, évalué à environ 2 000 emplois permanents pour un investissement de 100 milliards de dollars, soit un coût par emploi astronomique. Mais les habitants savent, par expérience, que ces promesses d'emplois technologiques sont souvent décevantes : les data centers automatisés créent peu de postes par rapport à leur taille, et les compétences requises ne correspondent pas à celles d'un ancien ouvrier sidérurgiste.

L'équation économique américaine est d'autant plus inquiétante qu'elle cumule les maux. On ne parle pas seulement de récession, mais de stagflation : une croissance anémique couplée à une inflation persistante. Les chiffres sont implacables. La croissance du PIB au quatrième trimestre 2025 a été révisée à la baisse pour n'atteurer que 0,5 %, une performance très en deçà des attentes .

Dans le même temps, l'inflation repart à la hausse. L'indice des prix à la consommation (CPI) a bondi à 3,3 % en mars 2026 sur un an, dopé par une flambée des prix de l'énergie de 10,9 % sur un seul mois . Cette poussée est en grande partie liée au conflit iranien qui a fait grimper les prix du pétrole au-dessus de 110 dollars le baril .

La Réserve fédérale est prise dans une paralysie stratégique sans précédent . Si elle baisse ses taux pour relancer la croissance, elle risque d'alimenter encore davantage l'inflation. Si elle maintient des taux élevés, elle asphyxie définitivement les secteurs du logement et de la manufacture. Résultat : les banques centrales sont impuissantes, les ménages subissent de plein fouet la hausse du coût de la vie, et la confiance dans les institutions s'effondre.

Le coût humain : suicides, désespoir et défiance

Les conséquences de cette crise économique multidimensionnelle ne se mesurent pas seulement en chiffres. Elles se mesurent en vies humaines brisées. Aux États-Unis, le taux de suicide a augmenté de façon constante depuis les années 2000, avec une accélération dans les zones rurales et désindustrialisées. Les « morts de désespoir » (suicides, overdoses, maladies liées à l'alcool) sont devenues un marqueur tragique de l'effondrement du rêve américain.

Face à cette détresse, l'arrivée d'un projet comme « Wonder Valley » suscite une défiance compréhensible. Ce n'est pas un hasard si les habitants ont crié « Honte ! Honte ! » et « Les gens avant les profits » lors du vote des commissaires le 4 mai. Ce n'est pas un hasard si l'activiste Natalie Clark a déclaré que les résidents refusent de « subventionner leur propre mort ». Cette colère est le reflet d'une Amérique abandonnée par ses élites, livrée aux appétits des milliardaires de la tech pendant que ses ressources s'épuisent, que son pouvoir d'achat s'effondre et que ses emplois disparaissent.

Dans ce contexte, l'hypothèse d'un système de surveillance géant n'a plus rien d'une paranoïa. Elle devient, pour une population qui a tout perdu, la dernière étape logique d'une prédation : après avoir pris l'eau, pris l'air, pris l'argent, l'État technocratique et ses alliés milliardaires voudraient-ils aussi prendre la liberté, la pensée, l'identité ? C'est cette angoisse existentielle qui rend la bataille contre « Wonder Valley » bien plus qu'une simple lutte environnementale. C'est une lutte pour l'âme même de l'Amérique, d’une Amérique rongée par la dette, étranglée par l’inflation, désindustrialisée et traversée par une crise de sens sans précédent.

08:14 Publié dans Actualité | Lien permanent | Commentaires (0) |  |

| ![]() Facebook | | |

Facebook | | |

22/05/2026

RTX 5060 la carte graphique 2026

Quand on construit ou améliore son PC, le choix de la carte graphique reste la décision la plus stratégique. Celle qui déterminera si l'on pourra lancer les jeux du moment en 2026, si l'on devra baisser les détails dans un an, et surtout, si l'on fait un achat avisé ou un placement discutable. Dans cette quête, deux modèles reviennent souvent dans les discussions : la RTX 5060 et la RX 6750 XT, autrefois rivales sur le papier. Mais les prix de 2026 ont tout changé. Et si la RTX 5060 s'imposait comme le choix évident du joueur malin ?

Sous son capot, la GeForce RTX 5060 embarque la nouvelle architecture Blackwell de NVIDIA, gravée en 5 nm — un progrès technique qui se traduit directement par une efficacité énergétique remarquable. Le GPU GB206 intègre 3840 cœurs CUDA, 30 cœurs RT dédiés au ray tracing et 120 cœurs Tensor pour l'IA, avec un cache L2 de 32 Mo. Ces chiffres pourraient sembler abstraits sans mise en perspective. Sachez qu'en 1080p ultra, la carte dépasse la RTX 4070 dans la majorité des jeux. Une prouesse qui en dit long sur l'efficacité de l'architecture Blackwell face à l'ancienne génération.

Sous son capot, la GeForce RTX 5060 embarque la nouvelle architecture Blackwell de NVIDIA, gravée en 5 nm — un progrès technique qui se traduit directement par une efficacité énergétique remarquable. Le GPU GB206 intègre 3840 cœurs CUDA, 30 cœurs RT dédiés au ray tracing et 120 cœurs Tensor pour l'IA, avec un cache L2 de 32 Mo. Ces chiffres pourraient sembler abstraits sans mise en perspective. Sachez qu'en 1080p ultra, la carte dépasse la RTX 4070 dans la majorité des jeux. Une prouesse qui en dit long sur l'efficacité de l'architecture Blackwell face à l'ancienne génération.

La mémoire mérite une attention particulière. NVIDIA a choisi 8 Go de GDDR7, la toute nouvelle génération de VRAM, cadencée à 28 Gbps sur un bus 128 bits. Sa bande passante atteint 448 Go/s, soit plus que celle de la RX 6750 XT et ses 432 Go/s, malgré un bus plus étroit. En clair, les 8 Go de GDDR7 sont plus rapides que les 12 Go de GDDR6 de sa concurrente. Cela ne compense pas totalement la différence de capacité, mais cela permet à la RTX 5060 d'exploiter ses 8 Go avec une efficacité maximale.

Un appétit mesuré : 145 W seulement

L'un des atouts majeurs de la RTX 5060 réside dans sa sobriété énergétique. Avec un TDP de seulement 145 W, elle consomme bien moins que les 250 W de la RX 6750 XT. Cela se traduit par une chaleur dégagée réduite — en jeu, les températures plafonnent autour de 61 °C sur les modèles bien conçus — et une facture électrique plus légère à l'usage. Pour les joueurs qui laissent tourner leur machine plusieurs heures par jour, l'écart devient significatif sur une année.

Autre conséquence directe : l'alimentation requise n'est que de 550 W, une recommandation très accessible. La RTX 5060 se glisse donc sans difficulté dans la plupart des configurations existantes, sans avoir à changer l'alimentation, à condition de disposer d'une connectique 8 broches standard. C'est un confort non négligeable, surtout pour ceux qui réalisent une mise à niveau progressive.

Autre conséquence directe : l'alimentation requise n'est que de 550 W, une recommandation très accessible. La RTX 5060 se glisse donc sans difficulté dans la plupart des configurations existantes, sans avoir à changer l'alimentation, à condition de disposer d'une connectique 8 broches standard. C'est un confort non négligeable, surtout pour ceux qui réalisent une mise à niveau progressive.

Passons maintenant à l'essentiel : combien de FPS la RTX 5060 délivre-t-elle vraiment ? Les benchmarks confirment des performances très solides pour sa catégorie.

En 1080p, son terrain de jeu naturel, la carte atteint sans peine 144 FPS+ dans les AAA récents, et dépasse les 240 FPS dans les jeux compétitifs. C'est précisément ce qu'il faut pour exploiter pleinement un écran 1080p à 144 Hz ou 240 Hz, sans aucun compromis sur les réglages. Dans Forza Horizon 5 en Ultra, les résultats parlent d'eux-mêmes avec 129 FPS. Les jeux exigeants comme Cyberpunk 2077 tournent autour de 83 FPS en natif, avec des réglages élevés, tandis que God of War Ragnarök atteint 112 FPS.

En 1440p, la carte montre encore de belles dispositions, surtout lorsque l'on active le DLSS. Dans ARC Raiders avec DLSS en mode performance, la RTX 5060 délivre 120 FPS. Counter-Strike 2 et Alan Wake 2 restent parfaitement jouables. On observe quelques FPS supplémentaires par rapport à la génération précédente : la RTX 5060 surpasse la RTX 4060 de 40 % environ, et talonne la RTX 4070 sur de nombreux titres.

| Jeu | RTX 5060 (FPS) | RX 6750 XT (FPS) |

|---|---|---|

| God of War Ragnarök | 112 | 100 |

| Forza Horizon 5 | 125 | 119 |

| The Last of Us Part II | 95 | 84 |

| S.T.A.L.K.E.R. 2 | 61 | 54 |

| Kingdom Come Deliverance 2 | 59 | 49 |

| Cyberpunk 2077 | 83 | 82 |

Données issues des tests comparatifs menés avec un Ryzen 7 9800X3D

La véritable arme secrète de la RTX 5060 réside dans DLSS 4 et sa Multi Frame Generation (MFG) qui permet de multiplier les images affichées par 4. C'est un bond technologique considérable par rapport à la génération précédente. Le principe est simple : plutôt que de calculer chaque image à la puissance brute, l'IA génère des images intermédiaires, libérant ainsi la carte pour d'autres calculs.

Les résultats sont saisissants. Dans Star Wars Outlaws en 1440p avec path tracing activé, le rendu natif donne 90 FPS — déjà très honorable. Avec DLSS 4 et MFG x4, on atteint 194 FPS, sans artefacts visibles. Dans Hogwarts Legacy, toujours en 1440p avec ray tracing poussé au maximum, la carte passe de 62 FPS en natif à 161 FPS avec DLSS 4. Alan Wake 2 bénéficie d'une transformation encore plus spectaculaire : de 19 FPS à 102 FPS, de quoi rendre le path tracing enfin jouable sur une carte milieu de gamme.

Attention tout de même, la MFG a ses limites. Pour un ressenti optimal, il est recommandé d'avoir une base d'au moins 50 à 70 FPS en rendu natif, sans quoi l'expérience peut devenir moins agréable en raison des latences. Mais sur la RTX 5060, ce cas de figure reste rare lorsqu'on utilise les réglages adaptés — typiquement en 1080p, où la carte excelle de toute façon.

Le ray tracing enfin accessible

Autre domaine où la RTX 5060 brille : le ray tracing. Avec ses 30 cœurs RT de quatrième génération et une puissance de calcul dédiée de 58 TFLOPS, la carte ouvre les portes d'un éclairage réaliste sans faire fondre les performances. Associé au DLSS 4, le ray tracing devient confortable, même en 1440p. Des jeux comme Doom: The Dark Ages tirent pleinement parti de cette synergie, avec un rendu fluide et des effets lumineux d'une qualité inédite pour une carte de cette gamme.

Bien sûr, il ne faut pas s'attendre à une expérience de path tracing intégral en 1440p — c'est le domaine des cartes bien plus chères. Mais pour du ray tracing classique, la RTX 5060 fait largement le travail, là où la RX 6750 XT, avec ses cœurs RT de première génération, peine souvent à suivre. AMD a beaucoup progressé sur ce terrain depuis, mais la génération RDNA 2 commence à montrer ses limites.

Les revendeurs partenaires peuvent également proposer des offres, et ASUS inclut généralement sa suite logicielle GPU Tweak III, permettant d'overclocker, de surveiller les températures et de personnaliser le ventilateur. Un petit plus qui apporte une réelle valeur ajoutée pour les utilisateurs souhaitant tirer le meilleur de leur matériel.

Pilotes NVIDIA : le suivi professionnel

Au-delà des performances brutes, NVIDIA bénéficie d'un des meilleurs soutiens logiciels du marché. Les GeForce Game Ready Drivers sont mis à jour régulièrement, avec des optimisations spécifiques pour les nouvelles sorties. C'est un luxe parfois sous-estimé, mais crucial pour ceux qui jouent aux titres dès leur lancement. Pour les créateurs de contenu, les Studio Drivers offrent une stabilité renforcée sur les logiciels de montage vidéo, de modélisation 3D ou de streaming.

Au-delà des performances brutes, NVIDIA bénéficie d'un des meilleurs soutiens logiciels du marché. Les GeForce Game Ready Drivers sont mis à jour régulièrement, avec des optimisations spécifiques pour les nouvelles sorties. C'est un luxe parfois sous-estimé, mais crucial pour ceux qui jouent aux titres dès leur lancement. Pour les créateurs de contenu, les Studio Drivers offrent une stabilité renforcée sur les logiciels de montage vidéo, de modélisation 3D ou de streaming.

En 2026, ce support s'avère plus important que jamais. AMD n'est pas en reste, mais la réactivité et la couverture des pilotes NVIDIA restent une référence dans l'industrie.

Revenons sur ce qui était autrefois un dilemme cornélien. La RX 6750 XT, malgré son âge (architecture RDNA 2 de 2021), conserve des qualités indéniables. Ses 12 Go de VRAM offrent une marge appréciable pour le 1440p, et ses performances brutes restent honorables. Mais en 2026, la donne a radicalement changé. Le modèle XFX Speedster MERC319, recommandé par de nombreux guides jusqu'à récemment, s'affiche désormais à des prix dépassant les 580 € sur les places de marché. Sur Amazon France, on le trouve parfois à plus de 640 €.

Pendant ce temps, la RTX 5060 ASUS Prime OC est disponible à 330 € sur Amazon France. L'écart atteint presque 250 €. C'est une somme qui change tout : pour le prix d'une seule RX 6750 XT, on pourrait presque s'offrir deux RTX 5060 — ou une RTX 5060 et un excellent écran. À performances équivalentes, la RTX 5060 est tout simplement moins chère, plus récente, plus sobre et mieux soutenue. Un choix devenu évident.

Les performances en 1080p sont quasi identiques

Il faut le dire clairement : en 1080p, les deux cartes se valent. Sur les dix jeux testés, la RTX 5060 l'emporte dans six titres, la RX 6750 XT dans quatre. La marge est inférieure à 10 % dans presque tous les cas. Mais quand la RTX 5060 coûte près de 250 € de moins, cette quasi-égalité devient une victoire écrasante pour la carte de NVIDIA. Les tests synthétiques confirment : la RTX 5060 est 0,3 % plus rapide que la RX 6750 XT, soit une différence parfaitement indétectable en jeu, mais à un prix de vente inférieur de près de 9 % en moyenne. Sur Amazon, l'avantage prix de la RTX 5060 est bien plus marqué encore.

Il serait malhonnête d'éluder la question de la VRAM. 8 Go, c'est le strict minimum en 2026. Certains jeux très exigeants en 1440p commencent à saturer cette capacité, comme le montrent les tests de Doom: The Dark Ages en WQHD, où la RTX 5060 voit ses performances limitées par le manque de mémoire vive. C'est un constat partagé par de nombreux testeurs : "8 Go de VRAM sont trop justes pour le 1440p".

Pourtant, cette limitation a une explication claire : le prix de la mémoire GDDR7 explose. Pour maintenir un tarif accessible à 330 €, NVIDIA a dû faire un choix assumé. Mettre 12 ou 16 Go de GDDR7 aurait fait grimper le prix de 100 à 150 € supplémentaires, plaçant la carte dans une gamme de prix bien différente, où elle aurait dû affronter des concurrentes autrement plus puissantes. Dans une période marquée par une pénurie mondiale de mémoire et une flambée des coûts, NVIDIA a fait le choix de privilégier l'accessibilité plutôt que la surabondance. C'est un pari compréhensible, surtout pour une carte destinée au 1080p, où 8 Go restent amplement suffisants pour l'immense majorité des titres.

Pour ceux qui jouent exclusivement en 1080p, le problème ne se pose quasiment jamais. Et pour ceux qui souhaitent s'aventurer en 1440p de manière occasionnelle, le DLSS 4 compense une partie du déficit de VRAM en allégeant la charge mémoire. La RTX 5060 n'est pas une carte pour le 1440p hardcore — ce n'est pas son positionnement. C'est une carte 1080p haut de gamme, et à ce jeu-là, elle excelle.

La RTX 5060 ASUS Prime OC : le modèle recommandé

Notre modèle de prédilection, la ASUS GeForce RTX 5060 Prime OC, se distingue par plusieurs atouts. Son système de refroidissement triple ventilateur Axial-tech et son format 2,5 slots assurent un refroidissement efficace tout en restant compatible avec les boîtiers compacts (certification SFF-Ready Enthusiast). La carte mesure 268,3 mm de long, ce qui lui permet de s'adapter à la plupart des boîtiers du marché, même les plus compacts.

Les fréquences sont généreuses : le mode OC pousse le boost jusqu'à 2.595 MHz (contre 2.565 MHz en mode par défaut). Trois DisplayPort 2.1b et un HDMI 2.1b offrent une connectivité complète, avec prise en charge du 8K à 60 Hz. À 330 € sur Amazon France, elle représente le meilleur rapport qualité-prix de sa catégorie.

La RTX 5060 est taillée pour plusieurs profils de joueurs. D'abord, ceux qui jouent en 1080p — la très grande majorité des joueurs sur PC — et qui souhaitent un débit d'images maximal dans tous les jeux, y compris les plus gourmands. Ensuite, les joueurs sensibles à la consommation et à la chaleur, qui veulent une configuration silencieuse et économe. Également, ceux qui privilégient les technologies : le DLSS 4, le ray tracing, le streaming avec l'encodeur AV1, et la suite logicielle NVIDIA.

Enfin, et surtout, la RTX 5060 s'adresse aux acheteurs avisés qui regardent le rapport qualité-prix plutôt que les fiches techniques absolues. À 330 €, elle surclasse sa concurrente AMD qui, à près de 250 € de plus, n'offre qu'un avantage marginal en VRAM. Un choix économique plus que justifié, surtout quand on sait que cette différence de prix permet d'investir dans un meilleur processeur, plus de RAM ou un écran plus performant.

Au terme de cette analyse, la RTX 5060 s'impose comme la carte graphique la plus intelligente à acheter en 2026. Non pas parce qu'elle est parfaite — les 8 Go de VRAM sont un regret compréhensible — mais parce qu'à 330 €, elle offre le meilleur compromis du marché. Performante, sobre, technologiquement avancée, et surtout, disponible à un prix qui rend caduque toute concurrence.

La RX 6750 XT a été une excellente carte en son temps. Mais en 2026, à près de 580 €, elle ne peut plus rivaliser. La RTX 5060 incarne la nouvelle donne : une carte qui mise sur l'efficacité et les technologies logicielles plutôt que sur la surenchère matérielle. Et c'est exactement ce qu'attendent la plupart des joueurs : une expérience fluide, belle et durable, sans exploser leur budget.

ASUS GeForce RTX 5060 Prime OC — 330 € sur Amazon France — la carte qu'il vous faut pour 2026.

08:13 Publié dans Actualité, Carte graphique | Lien permanent | Commentaires (0) |  |

| ![]() Facebook | | |

Facebook | | |

15/05/2026

L'agir communicationnel de Habermas est-il possible sur les plateformes numériques ?

Les réseaux sociaux devaient tenir une promesse : celle d'une parole enfin libérée, d'un débat ouvert à tous, d'une démocratie rendue à elle-même par la technique. Cette promesse avait quelque chose de philosophiquement séduisant — elle semblait prolonger, dans l'espace numérique, le vieux rêve d'une délibération rationnelle entre citoyens égaux. Pourtant, à mesure que les plateformes se sont imposées comme les infrastructures dominantes de notre vie publique, quelque chose s'est dérobé. Ce n'est pas que le débat ait disparu : il est partout, incessant, tonitruant. Mais peut-on encore appeler débat ce flux d'indignations concurrentes, de performances identitaires et de vérités tribales ? C'est à cette tension — entre la promesse d'un espace de raison partagée et la réalité d'un marché de l'attention — que l'œuvre de Jürgen Habermas nous invite à réfléchir. Non pour en déplorer nostalgiquement l'échec, mais pour en comprendre les mécanismes et, peut-être, en rouvrir les possibles.

À leur naissance, les réseaux sociaux ont été portés par une promesse démocratique séduisante. Twitter, Facebook, puis leurs successeurs se présentaient comme des espaces horizontaux où chaque voix, indépendamment de son origine sociale ou institutionnelle, pourrait prendre part à un débat public  ouvert. L'imaginaire qui les sous-tendait était celui d'une agora planétaire, d'une sphère publique reconstituée à l'ère numérique. Cette promesse résonnait, parfois explicitement, avec les intuitions de Jürgen Habermas, dont les premiers travaux avaient justement retracé l'émergence et la transformation de cet espace public (L'Espace public, 1962, rééd.). Dans cet ouvrage fondateur, Habermas décrivait comment, au XVIIIe siècle, des salons, des cafés et des sociétés de lecture avaient permis l'émergence d'un espace intermédiaire entre l'État et la société civile, où des citoyens privés formaient une opinion publique par la discussion critique. La promesse des plateformes numériques semblait prolonger cette histoire : après la sphère publique bourgeoise, après la sphère publique de masse des médias audiovisuels, l’internet ouvrait l’ère d’une sphère publique décentralisée, globale et interactive.

ouvert. L'imaginaire qui les sous-tendait était celui d'une agora planétaire, d'une sphère publique reconstituée à l'ère numérique. Cette promesse résonnait, parfois explicitement, avec les intuitions de Jürgen Habermas, dont les premiers travaux avaient justement retracé l'émergence et la transformation de cet espace public (L'Espace public, 1962, rééd.). Dans cet ouvrage fondateur, Habermas décrivait comment, au XVIIIe siècle, des salons, des cafés et des sociétés de lecture avaient permis l'émergence d'un espace intermédiaire entre l'État et la société civile, où des citoyens privés formaient une opinion publique par la discussion critique. La promesse des plateformes numériques semblait prolonger cette histoire : après la sphère publique bourgeoise, après la sphère publique de masse des médias audiovisuels, l’internet ouvrait l’ère d’une sphère publique décentralisée, globale et interactive.

Pour le philosophe de Francfort, une société émancipée ne peut se construire que sur la base d'un dialogue orienté vers la compréhension mutuelle — un dialogue où les participants acceptent de soumettre leurs prétentions à la validité à l'épreuve des raisons. Sa Théorie de l'agir communicationnel (1981) constitue l'un des édifices philosophiques les plus ambitieux de la seconde moitié du XXe siècle. Mais ce rêve a rapidement rencontré la réalité des architectures algorithmiques, des logiques économiques de l'attention et des dynamiques psychologiques de la polarisation. La question que nous allons examiner ici est donc celle-ci : les plateformes numériques permettent-elles un agir communicationnel authentique, ou constituent-elles au contraire le terrain d'élection d'un agir instrumental que Habermas lui-même avait identifié comme la pathologie centrale de la modernité ? Autrement dit, l’espace public numérique est-il un lieu de formation rationnelle de l’opinion ou un marché de l’attention où triomphe la stratégie ?

Rappel d'une théorie exigeante

Pour saisir l'enjeu du problème, il convient de rappeler avec précision ce qu'entend Habermas par « agir communicationnel ». Dans sa Théorie de l'agir communicationnel, il distingue fondamentalement deux types d'action sociale.

L'agir instrumental — ou stratégique — est celui par lequel un acteur traite autrui comme un moyen en vue de ses propres fins. Il relève d'une rationalité de type téléologique : ce qui compte, c'est l'efficacité, le résultat, la maximisation d'un avantage. Le paradigme de cet agir est la négociation marchande ou la manipulation politique : l'autre y est un obstacle à contourner ou un levier à actionner. Dans la sphère publique, l’agir stratégique se manifeste par la publicité (au sens de public relations), la propagande ou toute forme de communication qui cherche à produire des effets sans se soumettre au débat argumentatif.

L'agir communicationnel, en revanche, est orienté vers l'Einverständnis — l'entente. Il mobilise une rationalité d'un type radicalement différent, que Habermas appelle « rationalité communicationnelle ». Dans ce mode d'action, les participants s'engagent à soumettre leurs affirmations à trois types de prétentions à la validité : la vérité (ce que je dis est exact), la rectitude normative (ce que je fais est légitime) et la sincérité (ce que j'exprime correspond à ce que je pense réellement). Un dialogue authentiquement communicationnel implique que chacun accepte d'être convaincu par la « force non coercitive du meilleur argument ». Cette expression célèbre désigne un processus où la persuasion ne repose ni sur la force, ni sur l’argent, ni sur l’autorité, mais uniquement sur la qualité rationnelle des arguments échangés.

Ce modèle est exigeant. Il suppose une situation idéale de parole — concept régulateur et non description empirique — dans laquelle aucun participant ne serait a priori exclu, aucune contrainte extérieure ne biaiserait la discussion, et la seule force admise serait celle de la raison elle-même. Habermas est le premier à reconnaître que cette situation n'existe pas à l'état pur : elle est un horizon normatif, une idée régulatrice au sens kantien du terme. La question est donc de savoir si les plateformes numériques s'approchent ou s'éloignent de cet horizon.

Ce que les plateformes font au langage

Pour répondre à cette question, il faut analyser ce que les plateformes font concrètement au langage et à la communication. Et le constat, à cet égard, est troublant.

La grammaire de l'attention contre la grammaire du dialogue

Les plateformes sont des industries de l'attention. Leur modèle économique repose sur la maximisation du temps passé par l'utilisateur — ce que les ingénieurs de la Silicon Valley appelaient, avec une franchise désinvolte, l'engagement. Or, ce  qui capte l'attention n'est pas ce qui est vrai, ni ce qui est normatif, ni ce qui est sincère : c'est ce qui est saillant, clivant, émotionnellement chargé. Le théoricien des médias Tim Wu a montré dans The Attention Merchants (2016) comment cette logique de capture de l’attention, née dans la presse populaire du XIXe siècle, a trouvé son apogée avec les plateformes numériques.

qui capte l'attention n'est pas ce qui est vrai, ni ce qui est normatif, ni ce qui est sincère : c'est ce qui est saillant, clivant, émotionnellement chargé. Le théoricien des médias Tim Wu a montré dans The Attention Merchants (2016) comment cette logique de capture de l’attention, née dans la presse populaire du XIXe siècle, a trouvé son apogée avec les plateformes numériques.

Les recherches en sciences cognitives et en psychologie sociale ont abondamment documenté ce phénomène. Les contenus qui génèrent de l'indignation, de la peur ou du dégoût se propagent plus rapidement que ceux qui suscitent de la réflexion ou de la nuance. Comme l'ont montré Sinan Aral et ses collègues du MIT, les fausses informations circulent sur Twitter jusqu'à six fois plus vite que les vraies, précisément parce qu'elles exploitent ces biais émotionnels (The spread of true and false news online, Science, 2018). Cela signifie que l'architecture même des plateformes pénalise ce qu'Habermas appelle les « actes de langage » orientés vers la compréhension, et qu'elle récompense les actes de langage stratégiques — ceux qui visent à impressionner, à mobiliser, à polariser plutôt qu'à convaincre. L’économiste de l’attention, on le voit, n’est pas l’allié du débat rationnel.

La temporalité contre la délibération

L'agir communicationnel suppose du temps. La délibération raisonnée requiert la possibilité de formuler des arguments complexes, de les étayer, de les soumettre à l'objection, d'intégrer la réponse de l'interlocuteur. Elle est structurellement  incompatible avec la temporalité des réseaux sociaux : le flux ininterrompu, la réaction immédiate, la compression du langage en 280 caractères ou en formats éphémères. Cette temporalité produit ce que le philosophe Bernard Stiegler appelait une « prolétarisation de la pensée » (La Société automatique, 2015) : non pas l'appauvrissement des individus, mais celui des processus cognitifs collectifs eux-mêmes, réduits à des réflexes pavloviens plutôt qu’à des délibérations. Le tweet n'est pas seulement court — il est structurellement conçu pour court-circuiter la réflexion. Le format « story », qui disparaît au bout de vingt-quatre heures, accentue encore cette éphémérité qui contredit l’exigence de mémoire et de reprise propre à la formation rationnelle de l’opinion.

incompatible avec la temporalité des réseaux sociaux : le flux ininterrompu, la réaction immédiate, la compression du langage en 280 caractères ou en formats éphémères. Cette temporalité produit ce que le philosophe Bernard Stiegler appelait une « prolétarisation de la pensée » (La Société automatique, 2015) : non pas l'appauvrissement des individus, mais celui des processus cognitifs collectifs eux-mêmes, réduits à des réflexes pavloviens plutôt qu’à des délibérations. Le tweet n'est pas seulement court — il est structurellement conçu pour court-circuiter la réflexion. Le format « story », qui disparaît au bout de vingt-quatre heures, accentue encore cette éphémérité qui contredit l’exigence de mémoire et de reprise propre à la formation rationnelle de l’opinion.

L'identité performative contre la sincérité

La troisième prétention à la validité de l'agir communicationnel est la sincérité. Or les réseaux sociaux sont des scènes de construction identitaire permanente. Chaque publication est une mise en scène du soi, calculée pour maximiser l'approbation sociale (les « likes »), pour consolider une réputation, pour affirmer une appartenance tribale. Erving Goffman avait décrit ce phénomène dans la vie sociale ordinaire, mais les plateformes l'intensifient jusqu'à la caricature. On ne dialogue pas sur les réseaux sociaux : on performe. Et cette performance est, au sens strict habermasien, une forme d'agir stratégique — même lorsqu'elle prend l'apparence d'un argument. Le sociologue Pierre Bourdieu aurait sans doute parlé de « capital symbolique » numérique, une forme de pouvoir qui s’accumule par la visibilité et l’audience, rendant la recherche de la sincérité subordonnée à la maximisation de l’influence.

La quantification et le ranking comme méta-contrainte

Un aspect supplémentaire, souvent sous-estimé, est la quantification permanente à laquelle sont soumis les échanges : compteurs de likes, de retweets, de partages, classements, algorithmes de recommandation. Cette métrique omniprésente transforme tout acte de parole en un signal destiné à être évalué par un système. Dès lors, même un message sincère est contraint de s’ajuster à ce qu’il anticipe comme « performant » auprès de l’algorithme. Comme le souligne l’anthropologue Nick Seaver, les algorithmes de recommandation ne se contentent pas de filtrer l’information : ils orientent la production même de la parole. Nous sommes ainsi confrontés à une forme inédite de « contrainte systémique », bien plus diffuse et internalisée que les classiques asymétries d’information analysées par Habermas.

La colonisation du monde vécu par la logique des systèmes

La théorie d'Habermas offre un autre concept particulièrement pertinent pour analyser ce phénomène : celui de « colonisation du monde vécu » (Lebenswelt). Dans sa théorie sociale, Habermas distingue le monde vécu — l'ensemble des pratiques, des normes et des formes de vie partagées qui constituent le fond de l'existence sociale — des systèmes que sont l'économie marchande et l'appareil d'État. Ces systèmes fonctionnent selon leurs propres logiques (l'argent, le pouvoir), et tendent à envahir des domaines de la vie sociale qui devraient relever de la coordination communicationnelle.

Cette colonisation est précisément ce qui se produit avec les plateformes numériques. Les réseaux sociaux ont introduit la logique du marché — maximisation de l'engagement, production de valeur actionnariale — dans ce qui aurait pu être un espace de délibération publique. L'espace public numérique n'est pas un forum : c'est un marché de l'attention dont les règles sont fixées par des entreprises privées, dont les algorithmes sont opaques et dont les intérêts économiques sont structurellement antagonistes avec ceux d'un dialogue rationnel. Habermas lui-même, dans ses écrits plus récents, a analysé cette transformation avec une inquiétude croissante. Dans Un nouvel obscurantisme ? La crise de la démocratie à l'ère numérique (2022), il exprime une inquiétude profonde devant ce qu'il perçoit comme une fragmentation de l'espace public en bulles hermétiques, incapables de produire l'opinion publique rationnellement formée qu'exige une démocratie délibérative. Il y voit un phénomène de « reféodalisation » de la sphère publique : au lieu de l’échange argumenté entre citoyens, on retrouve une structure de publicité contrôlée par des acteurs puissants, comparable aux cours princières qu’il avait décrites dans L’Espace public.

La critique de la colonisation par la philosophie sociale contemporaine

Cette analyse a été reprise et approfondie par Axel Honneth, disciple d’Habermas,  qui insiste sur les pathologies sociales liées à la marchandisation des sphères de reconnaissance. Dans Le Droit de la liberté (2011), Honneth montre comment les médiations systémiques (argent, pouvoir, et aujourd’hui données) déforment les relations intersubjectives. Les plateformes, en privatisant l’expression publique et en réduisant les échanges à des transactions de données, réalisent une forme extrême de cette colonisation. Le « capitalisme de surveillance » décrit par Shoshana Zuboff (The Age of Surveillance Capitalism, 2019) en est l’expression la plus aboutie : l’expérience humaine, et notamment la communication, y est transformée en matière première pour des prédictions comportementales, court-circuitant ainsi toute possibilité d’autonomie communicationnelle.

qui insiste sur les pathologies sociales liées à la marchandisation des sphères de reconnaissance. Dans Le Droit de la liberté (2011), Honneth montre comment les médiations systémiques (argent, pouvoir, et aujourd’hui données) déforment les relations intersubjectives. Les plateformes, en privatisant l’expression publique et en réduisant les échanges à des transactions de données, réalisent une forme extrême de cette colonisation. Le « capitalisme de surveillance » décrit par Shoshana Zuboff (The Age of Surveillance Capitalism, 2019) en est l’expression la plus aboutie : l’expérience humaine, et notamment la communication, y est transformée en matière première pour des prédictions comportementales, court-circuitant ainsi toute possibilité d’autonomie communicationnelle.

La polarisation comme pathologie communicationnelle

La polarisation politique observée dans la plupart des démocraties depuis la montée en puissance des réseaux sociaux peut être lue, à travers la grille habermasienne, comme une pathologie communicationnelle de première grandeur.

La polarisation ne signifie pas simplement que les gens sont en désaccord — le désaccord est la condition normale et saine du débat démocratique. Elle signifie que les conditions mêmes du désaccord raisonné sont détruites : les interlocuteurs ne partagent plus de prémisses communes, ne s'accordent plus sur les mêmes faits, et ne reconnaissent plus à l'adversaire la bonne foi minimale qui rend le dialogue possible. Les bulles de filtre (filter bubbles) décrites par Eli Pariser (The Filter Bubble, 2011) constituent, en ce sens, une destruction des conditions préalables de l'agir communicationnel. Lorsque chaque groupe social vit dans un écosystème informationnel distinct, hermétique aux réfutations, la situation idéale de parole devient non seulement irréalisable, mais littéralement impensable. Le désaccord ne porte plus sur des prétentions à la validité soumises à l'examen critique : il porte sur des visions du monde incompatibles et non communicantes.

Les plateformes ne se contentent pas de créer des bulles : elles favorisent activement ce que le chercheur en psychologie sociale Jonathan Haidt appelle la «  dégradation de la conversation civique ». Les algorithmes, en optimisant l’engagement, promeuvent les contenus les plus clivants, ceux qui activent des émotions morales comme l’indignation ou le mépris. Or, comme le rappelle la philosophe Martha Nussbaum, l’indignation morale peut certes être un moteur de justice, mais elle est aussi, sur les réseaux, un puissant vecteur de déshumanisation de l’adversaire. La rationalité communicationnelle suppose la reconnaissance réciproque des participants comme des sujets capables de prendre position ; la logique algorithmique, en amplifiant le mépris, tend à transformer l’autre en un pur objet de dénonciation.

dégradation de la conversation civique ». Les algorithmes, en optimisant l’engagement, promeuvent les contenus les plus clivants, ceux qui activent des émotions morales comme l’indignation ou le mépris. Or, comme le rappelle la philosophe Martha Nussbaum, l’indignation morale peut certes être un moteur de justice, mais elle est aussi, sur les réseaux, un puissant vecteur de déshumanisation de l’adversaire. La rationalité communicationnelle suppose la reconnaissance réciproque des participants comme des sujets capables de prendre position ; la logique algorithmique, en amplifiant le mépris, tend à transformer l’autre en un pur objet de dénonciation.

Crispin Sartwell a parlé à cet égard d'une « épistémologie tribale » : non plus la recherche collective de la vérité, mais la consolidation identitaire de récits qui ne prétendent même plus à l'universalité. C'est l'exact opposé de ce qu'Habermas entend par rationalité communicationnelle. Le phénomène de la post-vérité, qui a fait l’objet de nombreux travaux (Lee McIntyre, Post-Truth, 2018), illustre ce point : lorsque les faits deviennent interchangeables selon l’identité de groupe, la prétention à la vérité perd sa fonction critique. Or, rappelons-le, la prétention à la vérité est l’une des trois dimensions de la validité dans la théorie habermasienne. Sa suspension revient à abolir le débat rationnel.

Y a-t-il des contre-exemples ? La résistance à la thèse

Il serait intellectuellement malhonnête de ne pas examiner les contre-arguments. Plusieurs faits empiriques et plusieurs positions théoriques viennent nuancer, voire contester, le diagnostic pessimiste exposé jusqu'ici.

Les réseaux sociaux ont été des vecteurs essentiels de mobilisations politiques progressives donc objectivement utile au capitalisme en crise : du Printemps arabe aux mouvements #MeToo et Black Lives Matter. Ces mobilisations ont permis à des voix marginalisées d'accéder à la sphère publique, contournant les filtres des médias traditionnels eux-mêmes souvent oligopolistiques. En ce sens, les  plateformes ont pu fonctionner comme des instruments d'élargissement de la délibération publique, permettant à des groupes exclus de faire entendre leurs prétentions normatives et conformistes. La philosophe Nancy Fraser, dans une célèbre critique de Habermas, avait souligné que l’espace public bourgeois était lui-même structuré par des exclusions (de genre, de classe, de race). Les contre-publics subalternes, qu’ils soient féministes, antiracistes ou ouvriers, ont toujours dû inventer des espaces de parole alternatifs. Les réseaux sociaux, vus sous cet angle, pourraient apparaître comme les contre-publics numériques d’aujourd’hui (Rethinking the Public Sphere, 1990).

plateformes ont pu fonctionner comme des instruments d'élargissement de la délibération publique, permettant à des groupes exclus de faire entendre leurs prétentions normatives et conformistes. La philosophe Nancy Fraser, dans une célèbre critique de Habermas, avait souligné que l’espace public bourgeois était lui-même structuré par des exclusions (de genre, de classe, de race). Les contre-publics subalternes, qu’ils soient féministes, antiracistes ou ouvriers, ont toujours dû inventer des espaces de parole alternatifs. Les réseaux sociaux, vus sous cet angle, pourraient apparaître comme les contre-publics numériques d’aujourd’hui (Rethinking the Public Sphere, 1990).

Le plaidoyer de Yochai Benkler

Le juriste et économiste Yochai Benkler a défendu, dans The Wealth of Networks (2006), une vision optimiste de l'internet comme espace de production de biens communs informationnels, fondé sur une logique de partage et de coopération. Pour Benkler, la communication en réseau permet des formes d'action collective décentralisée qui échappent à la fois à la logique marchande et à la logique étatique — ce qui n'est pas sans rappeler l'idéal habermasien d'une délibération libérée de la colonisation systémique. Il oppose ce modèle à celui des médias de masse, qui étaient structurellement centralisés. Selon lui, la diversité des sources et la réduction des coûts de participation ouvrent des potentialités démocratiques inédites.

Les communautés délibératives en ligne

Des recherches en communication politique ont identifié des espaces numériques où quelque chose ressemblant à un dialogue rationnel semble se produire : certains forums spécialisés, certaines plateformes de délibération citoyenne (comme les assemblées citoyennes numériques utilisées dans certains processus participatifs), ou encore certaines communautés académiques en ligne. Des exemples comme Wikipedia, dont la gouvernance repose sur des principes de discussion argumentée, montrent qu’il est possible de concevoir des infrastructures numériques qui ne sont pas captives de la logique de l’attention. De même, les expériences de « démocratie délibérative assistée par algorithme » (par exemple, les assemblées citoyennes irlandaises) suggèrent que l’outil numérique peut, dans des cadres institutionnels adéquats, servir la délibération.

La nuance nécessaire

Ces contre-exemples sont réels, mais ils pointent vers une conclusion précise : l'agir communicationnel sur les plateformes n'est pas impossible en théorie, mais il est structurellement défavorisé par l'architecture économique et algorithmique  des grandes plateformes commerciales. Il survit dans des niches, malgré le système, non grâce à lui. Comme le note l’analyste des technologies Evgeny Morozov dans Pour tout résoudre, cliquez ici (2013), la question n’est pas de savoir si le numérique peut être délibératif, mais quelles conditions institutionnelles, économiques et politiques doivent être réunies pour qu’il le devienne.

des grandes plateformes commerciales. Il survit dans des niches, malgré le système, non grâce à lui. Comme le note l’analyste des technologies Evgeny Morozov dans Pour tout résoudre, cliquez ici (2013), la question n’est pas de savoir si le numérique peut être délibératif, mais quelles conditions institutionnelles, économiques et politiques doivent être réunies pour qu’il le devienne.

Vers une éthique de la conception : peut-on repenser les plateformes ?

Si le problème est structurel, la réponse doit l'être aussi. C'est ici que la théorie d'Habermas acquiert une dimension proprement normative et programmatique.

Si l'on accepte que les plateformes actuelles constituent un obstacle à la rationalité communicationnelle non pas par accident mais par design — c'est-à-dire parce qu'elles sont délibérément conçues pour maximiser l'engagement plutôt que l'entente —, alors la question politique et éthique devient : quelles architectures numériques favoriseraient au contraire l'agir communicationnel ?

Plusieurs pistes ont été explorées. La régulation par les pouvoirs publics — sur le désastreux modèle post-soviétique du Digital Services Act européen — vise à introduire des obligations de transparence et de responsabilité dans le fonctionnement des algorithmes. Des chercheurs comme Shoshana Zuboff ont plaidé pour des formes de régulation de ce qu'elle appelle le « capitalisme de surveillance », un régime économique qui, en privatisant l'expérience humaine comme matière première, détruit les conditions mêmes de l'autonomie et de la délibération démocratiques (The Age of Surveillance Capitalism, 2019). La reconnaissance d’un droit à ne pas être profilé, ou encore la mise en place d’une autorité indépendante de contrôle des algorithmes, seraient des mesures concrètes visant à décoloniser l’espace public numérique.

Les communs numériques et l’alternative des plateformes non commerciales

D'autres ont exploré l'idée de plateformes à but non lucratif, ou de protocoles décentralisés (comme ActivityPub, qui sous-tend Mastodon), qui découplent la communication en réseau de la logique de monétisation de l'attention. Le mouvement des communs numériques (par exemple, Framasoft en France) propose des services libres, éthiques et décentralisés qui redonnent aux utilisateurs la maîtrise de leurs données et de leur espace de parole. Ces architectures alternatives cherchent précisément à recréer les conditions d'un espace public numérique qui ne soit pas colonisé par la logique marchande.

Éduquer à la délibération numérique

La réflexion habermasienne invite également à penser l'éducation au numérique non pas simplement comme une formation aux usages des outils, mais comme une formation à la délibération — ce que certains appellent une « littératie démocratique numérique » : la capacité à identifier les prétentions à la validité, à distinguer l'argument de la manipulation, à reconnaître les biais algorithmiques qui structurent sa propre vision du monde. L’École, mais aussi les médias de service public, ont un rôle essentiel à jouer dans cette pédagogie de la rationalité communicationnelle.

Repenser la propriété des infrastructures

Enfin, une approche plus radicale, défendue par Nick Srnicek dans Capitalisme de  plateforme (2016), suggère que seule une transformation structurelle de la propriété des infrastructures numériques pourrait permettre un véritable espace public délibératif. Srnicek propose de socialiser les plateformes, c’est-à-dire de les faire passer sous contrôle public ou collectif, afin de les soustraire à l’impératif de maximisation du profit et de l’engagement. Une telle orientation irait dans le sens de la critique habermasienne de la colonisation : il s’agirait de dé-systémiser l’espace public en le retirant à la logique de l’argent. Il se garde de préciser que cette logique est aussi celle pas moins dangereuse de l' État.

plateforme (2016), suggère que seule une transformation structurelle de la propriété des infrastructures numériques pourrait permettre un véritable espace public délibératif. Srnicek propose de socialiser les plateformes, c’est-à-dire de les faire passer sous contrôle public ou collectif, afin de les soustraire à l’impératif de maximisation du profit et de l’engagement. Une telle orientation irait dans le sens de la critique habermasienne de la colonisation : il s’agirait de dé-systémiser l’espace public en le retirant à la logique de l’argent. Il se garde de préciser que cette logique est aussi celle pas moins dangereuse de l' État.

Un horizon normatif sous pression

La réponse à notre question initiale est donc nuancée, mais pas équivoque. L'agir communicationnel au sens habermasien n'est pas radicalement impossible sur les plateformes numériques — des îlots de délibération authentique y existent. Mais il y est structurellement contrarié par des logiques économiques, algorithmiques et psychologiques qui favorisent systématiquement l'agir stratégique. Les promesses d’une agora numérique se sont heurtées à la réalité d’un marché de l’attention privatisé, où les conditions mêmes de la délibération (temps, sincérité, prétention à la vérité) sont dégradées.

Ce que révèle l'application de la théorie habermasienne aux réseaux sociaux, c'est moins une réfutation de cette théorie qu'une confirmation de son diagnostic sur les pathologies de la modernité. La colonisation du monde vécu par la logique des systèmes que décrivait Habermas en 1981 a trouvé, avec les plateformes numériques, son expression la plus accomplie et la plus globale. Le capitalisme de surveillance représente sans doute l’une des figures les plus radicales de cette colonisation, puisqu’il transforme l’interaction communicationnelle elle-même en une source de profit par la prédiction comportementale.

Mais l'horizon normatif demeure. La situation idéale de parole n'est pas une description du monde tel qu'il est : c'est une exigence qui nous permet de mesurer l'écart entre ce qui est et ce qui devrait être, et d'orienter l'action vers la réduction de cet écart. C'est peut-être là la contribution la plus durable de la philosophie habermasienne à la critique du numérique : non pas une nostalgie de la sphère publique bourgeoise qu'il avait lui-même analysée et critiquée, mais une boussole normative à l'aune de laquelle évaluer les architectures de la communication collective et exiger leur transformation.